Im Blogbeitrag „Erstellung von individuellen Renderings mit generativer KI“ haben Sie einen Überblick über das Potenzial von KI-Bildgeneratoren bekommen. Im Folgenden wird am Beispiel eines Möbels die Vorgehensweise zur Erstellung eines Renderings mit KI-Bildgeneratoren veranschaulicht.

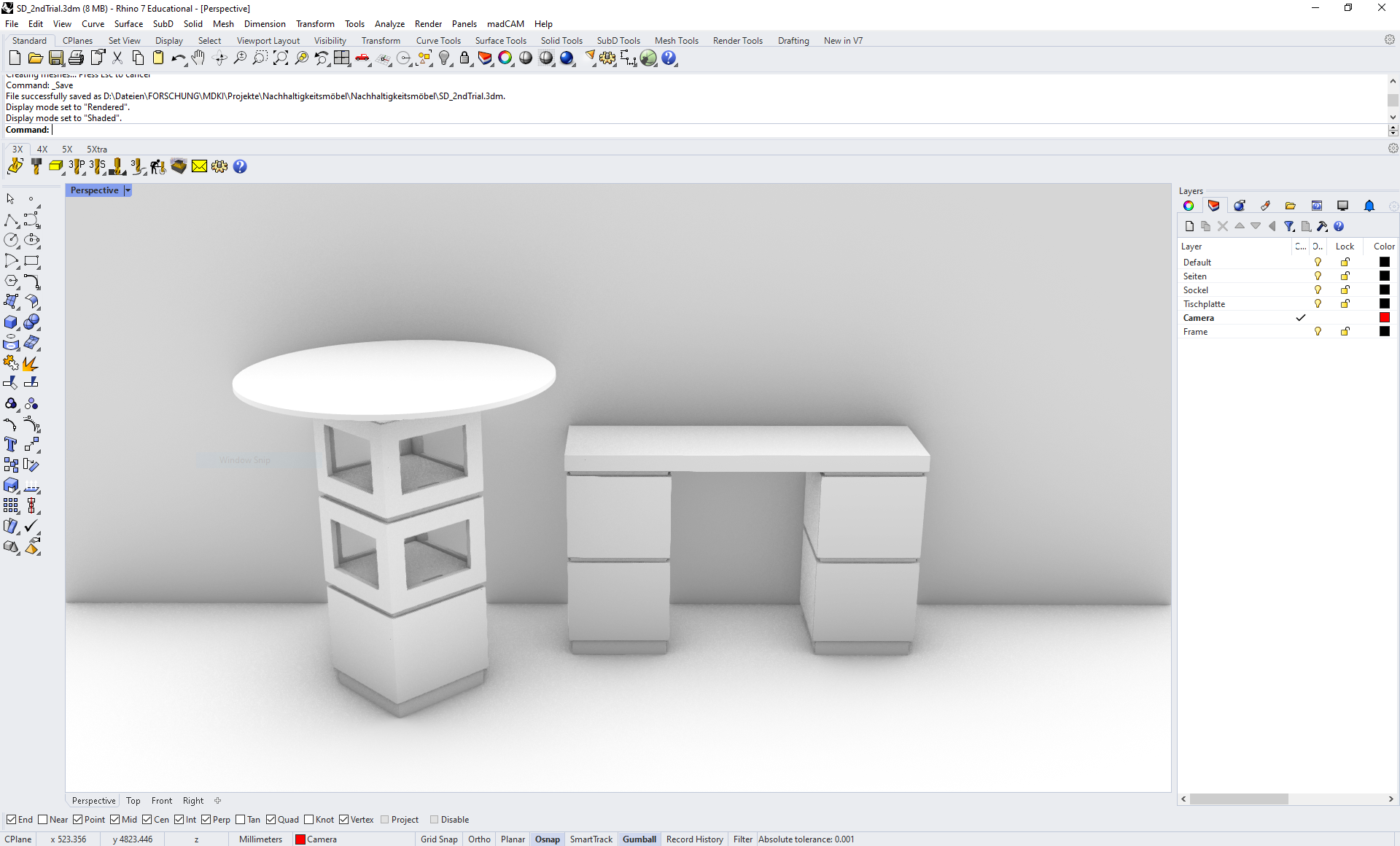

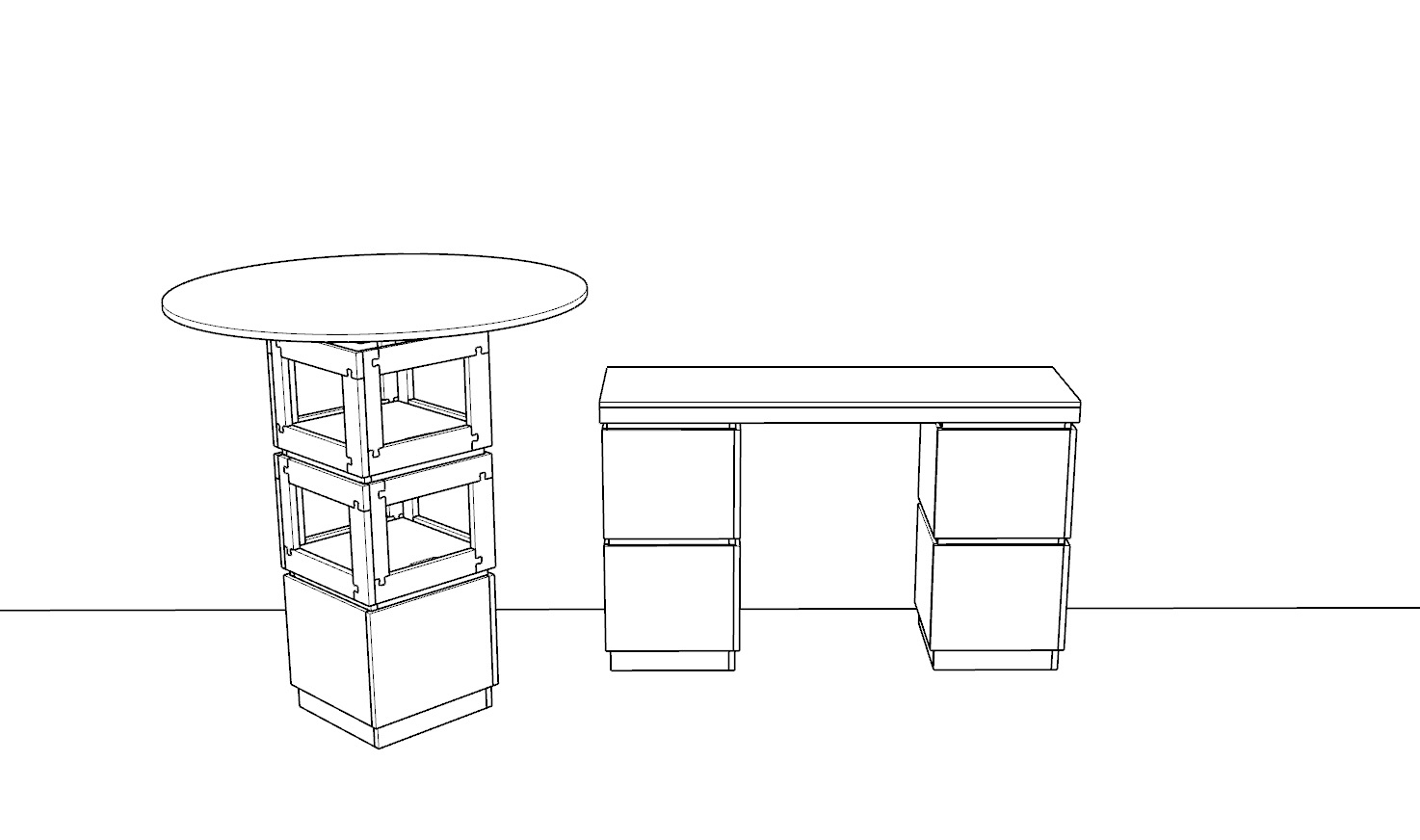

3D-Modell und technische Skizze

Grundlage des Renderns mit KI oder auf dem klassischen Weg ist ein einfaches 3D-Modell, welches lediglich geometrische Informationen beinhaltet. Genutzt wurde in diesem Fall das CAD-Programm Rhinoceros3D. Während für das klassische Rendern jetzt Materialien, Beleuchtung und Szenerie angelegt werden müssen, reicht es für die KI-Bildgeneratoren eine einfache Linienzeichnung abzuleiten, die später als Orientierungshilfe dient.

KI-Software und Tools

Für das Beispiel wird eine Distribution von Stable Diffusion gewählt. Hierbei handelt es sich um ein frei zugängliches Programm, welches durch eine Vielzahl an Erweiterungen und Einstellungsmöglichkeiten überzeugt. Durch die lokale Installation ist es auch möglich die Datenhoheit zu bewahren, was gerade bei sensiblen Projekten unverzichtbar ist. Zusätzlich wird das PlugIn ControlNet genutzt, welches erlaubt, die vorab generierte Strichzeichnung als Grundlage für die Bildgeneration zu nutzen.

Modell- und Parameterauswahl

Grundlage für die Bilderzeugung sind vortrainierte Modelle. Im Netz gibt es eine Vielzahl an unterschiedlichen Modellen, welche für unterschiedliche Anwendungsfälle trainiert wurden. Das eigens von Stable Diffusion trainierte Modell basiert auf ca. 5 Milliarden Bild-Text-Paaren und ist ein optimaler Allrounder. Andere Modelle sind besonders gut für fotorealistische Bilder, Comiczeichnungen oder Portraits geeignet. Für das Möbel wird das Model „RealisticVision5.1“ verwendet.

Die wichtigsten Parameter für die Bilderzeugung sind die Auflösung, der CFG-Scale, die Sampling-Steps und der Seed:

- Auflösung: Die Auflösung kann anfangs niedrig gewählt werden und sollte nicht höher als 1024x1024 Pixel sein, damit die Rechenzeit gering bleibt und es möglich ist, in kurzer Zeit viele unterschiedliche Designs zu testen. Einige Modelle neigen bei hohen Auflösungen auch zu Bildartefakten.

- Sampling-Steps: Die Sampling-Steps sind die Anzahl der Schritte, mit denen Stück für Stück das Rauschen aus dem Bild entfernt wird. 25 Steps sind ein guter Wert in der Testphase. Für ein finales Design können Sampling-Steps sowie auch die Auflösung dann erhöht werden.

- Seed: Diese Ganzzahl ist der Ausgangswert für den Zufallsgenerator und erlaubt es, mit den gleichen Ausgangsparametern verschiedene Bilder zu erzeugen.

- CFG-Scale: Der CFG-Scale bestimmt wie strikt sich die KI an den eingegebenen Prompt hält oder von diesem abweicht. Bei einem sehr niedrigen Wert entstehen KI-Halluzinationen, bei einem hohen Wert führt es zu ungewünschten Artefakten. Der empfohlene Wert liegt zwischen 7-10.

Prompting und Bildgeneration

Grundsätzlich gilt, je besser und detaillierter der Prompt ist, desto besser das Ergebnis. Ein guter Prompt enthält neben dem gewünschten Motiv auch Informationen zum Medium, der Stilrichtung, zusätzlichen Szenendetails, Farbe und Beleuchtung. Neben dem Prompt, in dem die Beschreibung des Bildes anhand kurzer Sätze und Schlüsselwörter erfolgt, bietet Stable Diffusion einen negativen Prompt, über den man nicht gewünschte Inhalte herausfiltern kann. Dieser wird oft genutzt, um Bildartefakte wie deformierte Gliedmaßen, Wasserzeichen, Bildsignaturen oder Deformationen zu unterdrücken.

Um das richtige Setting für die gewünschten Möbelrenderings zu finden, wurden mehrere Prompts getestet.

minimalist scandinavian wooden furniture, shabby chic, different colored timber, white wall background, wooden floor, loft, interior, warm soft light, low gloom, ultra hd, photo realistic

exotic wood, colorful wooden furniture, shabby chic, different colored timber, white wall background, wooden floor, loft, industrial, parquet, interior, warm soft light, low gloom, ultra hd, photo realistic, different brown color tones

exotic wood, colorful wooden furniture, shabby chic, different colored timber, wall with window in background, wooden floor, loft, industrial, parquet, interior, warm soft light, low gloom, ultra hd, photo realistic, different brown color tones

exotic wood, colorful wooden furniture, midcentury modern, different colored timber, wall with window in background, wooden floor, loft, industrial, parquet, interior, warm soft light, low gloom, ultra hd, photo realistic, different brown color tones

contemporary interior design furniture, in front of wall, window with nature, sustainability, greenhouse, warm soft light, low gloom, ultra hd, photo realistic

(art deco wooden furniture), maple wood, interior design, in front of wall, window with nature, sustainability, warm soft light, low gloom, ultra hd, photo realistic, spring colors

Das gewünschte Design muss nun noch auf die Zeichnung vom Möbel übertragen werden. Mit dem PlugIn ControlNET lässt sich die Strichzeichnung des Möbels als zusätzlicher Kontrollparameter einbinden. Um eine Auswahl an Bildern zu erhalten, wurde die Chargenanzahl auf 12 erhöht und die oben aufgeführten Prompts genutzt:

In der Bildgalerie am Ende dieses Beitrags können Sie die Ergebnisse des Renderings in einer vergrößerten Ansicht betrachten.

Nachbearbeitung

Die Gestaltung mit KI-Bildgeneratoren ist ein iterativer Prozess, der viel Experimentieren und Freude am Ausprobieren erfordert. Es empfiehlt sich immer, direkt mehrere Bilder zu erzeugen, da die KI oft Bilder erzeugt, die zwar optisch ansprechend aber nicht unbedingt realitätsnah sind. Das beste Bild aus einer Charge kann dann für die Veröffentlichung in Print oder im Web aufbereitet werden. Dazu wartet Stable Diffusion mit einer Reihe von Werkzeugen auf:

Inpaint: Mit Inpaint ist es möglich, bestimmte Bereiche eines Bildes auszuradieren und von der KI neu mit Inhalt füllen zu lassen. Ungewünschte Objekte oder zusätzliche Details können so in das Bild gebracht werden.

ADetailer: Der A(fter)Detailer erlaubt es, die Details eines Bildes hervorzuheben oder mehr Details hinzuzufügen. So können zum Beispiel Texturen verbessert oder die Szene lebendiger gestaltet werden.

Upscaler: Die Auflösung der Bilder ist nach der Generierung noch gering. In einem zweiten Schritt kann die Auflösung dann entsprechend des gewünschten Zielmediums hochskaliert werden. Der Upscaler fügt dem Bild beim Hochskalieren zusätzliche Schärfe hinzu und unterdrückt ebenfalls Rauschen, sodass die Bilder nicht verpixeln.

Vom 3D-Modell bis zum photorealistischen Rendering des Möbels gelangt man so in wenigen Minuten. Der Kreativität sind keine Grenzen gesetzt und der Einsatz ist in jeder beliebigen Branche möglich.

Wenn dieses Thema Ihr Interesse geweckt hat oder Sie sich für Ihre Produkte KI-Renderings vorstellen können, freuen wir uns von Ihnen zu hören. Wir bieten für kleine und mittlere Unternehmen (KMU) kostenfrei einen Workshop zur Einrichtung und Bedienung von Stable Diffusion an.